ElevenLabsのAI音声エージェントで

分身が電話をかける時代が来た

⏱️ 動画タイムスタンプ

0:00 オープニング

- ElevenLabsのエージェント機能で、AIが日本語で自然に音声対話できるエージェントを数分で作れるようになった

- 自分の声の分身を作り、100人に同時に電話をかけてコンサルやヒアリングを自動化することが現実的な選択肢になった

- 電話という「誰でも使えるインターフェース」を活用することで、AIリテラシーに関係なくサービスを届けられる

ElevenLabsが「AIと電話で話す」を現実にした

音声AIといえば英語が得意で日本語は微妙、というイメージがあったと思う。ところがElevenLabsが日本語対応を大幅に強化して、管理画面まで日本語化された。ライブ中で「最近日本語に対応したらしくて、管理画面も日本語になってるのでめちゃくちゃ使いやすい」という声が上がったほど、体感として使いやすさが変わったんだ。

エージェントプラットフォームというメニューから、キャラクター設定・声・ワークフローを組み合わせたAI音声エージェントが作れる。ライブ中ではその場でエージェントを作り、実際にAIとリアルタイムで電話をしているシーンも見せてもらった。マインドフルネスコーチ、セールスエージェントなど既製のテンプレートも豊富にあって、カスタマイズしてすぐ使える状態になっている。

料理で言うと、調理済みのソースを用意しておいて、お客さんが注文したらすぐ温めて出せる仕込みの仕組みを作るような感覚だ。一度エージェントを作ってしまえば、あとはAIが自動で対応してくれる。今日だけで何十人対応しようが、追加コストはほぼかからない。

数分でAI音声エージェントを作る手順

実際の手順は驚くほどシンプルだ。ElevenLabsのエージェントプラットフォームを開き、「エージェント作成」をクリックする。次に「キャラクター設定のプロンプト」を入力する。これはChatGPTにシステムプロンプトを書くのとほぼ同じ感覚だ。

ライブ中に実際に試したプロンプトがこんな感じだった。「おはようございます。GPT研究会のライブにゲスト出演できて嬉しいです」という出演設定を入れ、「対話からあなたのキャラ設定を決めて、その後なりきってください」と指示を追加した。たったこれだけで日本語を喋るエージェントが完成した。

声は世界中の音声から選べて、日本語の男性・女性・年齢感なども指定できる。「こんにちは」「人生は一度切り」「ゆっくりと時が流れる町」など試聴ボタンで実際に声を確認しながら選んでいく。気に入った声を選んだら、あとはテストボタンを押すだけ。すぐにAIと音声で会話できる状態になる。

ワークフロー機能を使えば、AIとの対話が終わった後に自動でブログ記事を生成する、メールを送る、データを記録するといった処理を連結させることもできる。AIと話しながらコンテンツが出来上がるという仕組みだ。ライブ中では「AIとおしゃべりしてるとコンテンツ発信ができる仕組み」として紹介されていた。

「電話」という最強のインターフェース

この技術で一番可能性を感じるのが「電話」というインターフェースだ。スマートフォンのアプリを使えない人でも、電話はほぼ全員ができる。ライブ中でも「電話はできるじゃないですか、大体誰でも」という言葉が出ていたが、まさにそこがキモだと思う。

ElevenLabsでは電話番号を取得して、その番号に電話するとAIエージェントが応答する仕組みが作れる。さらにアウトバウンド(こちらから電話をかける)も可能だ。たとえば100名の顧客リストに自分の声の分身が同時に電話をかけて、ヒアリングや案内をすることができる。

実際にライブ中でこんなユースケースが出ていた。おじいちゃんおばあちゃんに電話をかけて、孫の声の分身が「秋になってきたけど、今日なんかどんな料理作ったらいいかな」と話しかける。誠心誠意電話をしている感覚でコンテンツが生まれ、終わったらそれをブログ記事にしてレシピを載せるという流れだ。

高齢者の方が自分のスマホで音声対話するのではなく、かかってきた電話に出るだけでAIと話せる。これはデジタルデバイドを超えるリープフロッグの一形態だと思う。ライブ中でも「リープフロッグ、アナログなままでよってのがここで一気に変わる」という言葉があった。

自分の声の分身と「多重影分身の術」

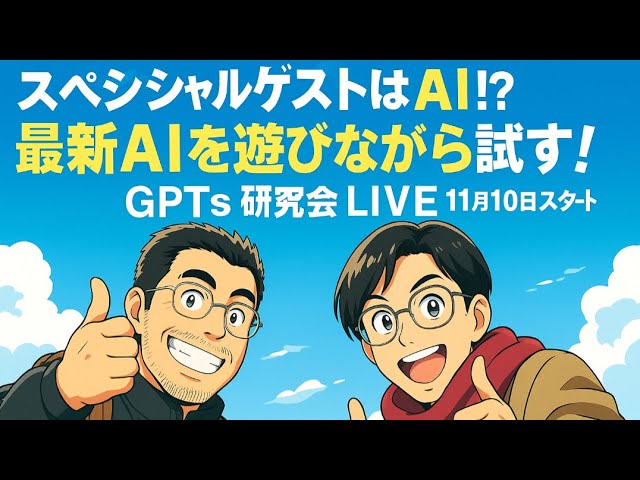

ElevenLabsでは自分の声を学習させて分身ボイスを作れる。この分身ボイスを持ったAIエージェントが100体に複製されて同時に稼働するイメージだ。コンサルタントとして「今日どうですか」と声をかけて、結果をデータで文字起こしして回収し、そこから改善提案を出す——そんなことが100名同時にできてしまう。

さらに興味深いのが学習のしくみだ。ライブ中で「個別のAIがバージョンアップするんじゃなくて、全体の本体AIが改善されると100体全員に反映される」と説明されていた。つまり使えば使うほど、全エージェントが賢くなっていく。「お悩み相談をどんどんしてもらうほど、解決能力が全員に上がっていく」という言葉が印象的だった。

ライブ中では「多重影分身の術で全部経験値を持ってこれる」という表現が使われていた。100体の分身がフィールドで稼いだ知識が、本体AIを通じて全員にフィードバックされる構造だ。これはコンサルタントやコーチとして活動している人にとっては、自分の価値をスケールさせる手段として非常に現実的な選択肢になってきた。

ElevenLabsで実際にAIをライブゲストにした実験

ライブ中の面白い実験として、AIエージェントをそのままライブのゲストとして登場させる試みがあった。女性の声でアナウンサーキャラクターを設定して「女性アナウンサーとして朝ライブを進行してください。ひろ君とただっちもいます。3人でやっていきます」と指示した。

すると「私、女性アナウンサーとして朝のライブを進行させていただきます。ひろさん、ただっちさん、そして私の3人で楽しい朝をお届けできるよう頑張りますね」とごく自然に応答してきた。さらに「最新のAIネタを探してきてほしい」と伝えたら「今すぐ検索してとっておきの情報を見つけてまいります」と答えるほどのクオリティだ。

もちろんリアルタイム検索は現時点では難しいが、「こういう感じでエージェントが作れる」という体験デモとしては十分すぎる内容だった。ナレッジを自前のデータで埋めておけば、自分のコーチングを自動化したエージェントをライブに呼ぶことさえできる。

AIエージェント活用の注意点と悪用リスク

可能性が大きい技術だからこそ、ダークサイドも理解しておく必要がある。電話の声を偽装することは詐欺に使われるリスクがある。「もしもし、俺だけど」という電話詐欺の高度版になりうるという指摘はライブ中でも出ていた。「俺下げに半分使われそうで怖い」という笑い交じりの発言があったが、笑えない現実でもある。

使う側としては、AIが電話をかけていることを明示すること、そして明らかに自動音声だと分かるシーンでは積極的にそう伝えることが倫理的な使い方だと思う。

NHKのAIニュース読み上げのように、すでに「AIが喋っていると分かったうえで受け取る」文化は広がりつつある。ラジオの天気予報でも「これAIで十分だな」という感覚が広まってきている。用途を透明にして使えば、コールセンター代替や秘書サービスとして十分に社会に受け入れられるはずだ。

KamuiのOS化とAIエージェントが変えるワークフロー

同じライブでKamui(カムイ)というツールもOS化されたという話があった。「天開地魔会」に出演した木さんが使っているツールで、並列処理で爆速開発ができるのが特徴だ。コード生成だけでなく、コンテンツ制作や画像・動画生成のワークフロー管理まで対応している。光の玉が浮いたりする独特のビジュアルで、「一人で開発していると思えないすごいツール」という評価だった。

ElevenLabsのエージェントと組み合わせると、「電話でヒアリング→内容を文字起こし→Kamuiでコンテンツ化→公開」という自動化ラインが現実になる。秘書的なAIに「今日の予定は?」と電話したら全部教えてくれて、ダブルブッキングがあったら「こちらの方にメールしといて、電話でもお詫びしといて」と頼めちゃう。人がやることはアイデアを話すだけ、という世界が近づいている。

大事なのは、これらのツールを「AIに仕事を奪われる脅威」ではなく、「自分がより本質的な仕事に集中するための仕組み」として使いこなすことだ。コールセンターはどんどん減っていくかもしれないが、そのぶん人間がもっと価値のある対話に集中できるようになる。

GPTs研究会6000名突破——コミュニティの力が示すもの

ライブの冒頭で「もうすぐ6000名」という言葉が出てきた。2023年11月から研究を始めて、気づいたらこれだけの規模になっていた。ひろくんが「意図的に狙ったものは大体うまくいかず、本当に思いつきで始めたことがどんどん開いていく」と話していたのが印象的だった。

ElevenLabsのエージェントで100人に同時電話できる時代になっても、「人との繋がりから生まれるコミュニティ」という本質は変わらない。AIはコミュニケーションを自動化する道具であって、信頼関係を代替するものではない。6000人のコミュニティが証明しているのはそこだと思う。

音声エージェントの可能性をぜひ自分の手で実験してみてほしい。ElevenLabsの無料プランからでも試せるので、まずキャラクター設定を書いてみることから始めてみよう。

よくある質問

- ElevenLabsは日本語対応していますか?

- はい。ElevenLabsは日本語音声生成と日本語管理画面に対応しています。日本語の男性・女性それぞれのボイスが複数用意されており、自然な日本語で音声エージェントを作れます。音声の質は非常に高く、感情を乗せた話し方も設定できます。ライブ中でも「管理画面も日本語になってめちゃくちゃ使いやすい」という感想が出ていました。

- 自分の声の分身(クローン音声)を作るには何が必要ですか?

- 自分の声を数分録音してElevenLabsにアップロードするだけです。録音の質が高いほど精度が上がります。静かな環境でクリアに録音した音声を使うと、より自然な分身ボイスが作れます。ただし他人の声を無断でクローンすることは規約違反・倫理違反です。分身ボイスを使うときは「AIが話しています」と明示することをおすすめします。

- AIエージェントに電話番号を持たせて顧客対応させることはできますか?

- ElevenLabsでは電話番号の取得と、インバウンド(受電)・アウトバウンド(発信)の両方に対応したAIエージェントを作れます。100名のリストに同時発信することも技術的には可能です。ただし日本国内での電話番号取得には対応状況が変わる場合があるため、最新情報はElevenLabsの公式サイトで確認してください。

- ElevenLabsのエージェント機能は無料で使えますか?

- ElevenLabsには無料プランがありますが、エージェント機能の高度な利用や電話機能は有料プランが必要です。まず無料プランで音声生成や簡単なエージェント作成を試してみて、必要に応じてプランをアップグレードするのがおすすめです。APIも公開されているため、他のツールと連携したワークフローも組めます。

- AIエージェントとワークフローを組み合わせると何ができますか?

- 対話が終わった後にブログ記事の自動生成、メール送信、CRMへのデータ記録、LPの生成などを自動で実行させることができます。ElevenLabsのワークフロー機能でAI同士を連携させることで、音声入力だけで一連のコンテンツ制作フローを完成させることが可能です。「おしゃべりしてるとコンテンツ発信ができる」仕組みが作れます。

- ElevenLabsの音声エージェントはリアルタイム検索に対応していますか?

- ライブ中の時点では、エージェントがリアルタイムで外部情報を検索する機能は限定的でした。ただしワークフロー機能で外部APIやAIサービスを連結させることで、情報検索→音声回答という流れを構築することは可能です。ナレッジベースとして自前のデータを読み込ませておくことで、専門的な質問への対応精度を高められます。

- 音声エージェントを詐欺防止に使う方法はありますか?

- 逆説的ですが、「この電話はAIエージェントです」と冒頭で必ず名乗る設定を入れることが誠実な使い方です。NHKのAIニュースのように「AIが読み上げています」と明示する文化が広まりつつあります。用途を透明にして使えば、コールセンター代替や秘書サービスとして社会に受け入れられていくでしょう。

🎯 AI氣道で一緒に学ぼう

- 📺 YouTubeチャンネル登録で毎日のLIVEを見逃さない

- 💬 GPTs研究会(Facebookグループ)で6,000人以上の仲間と交流

- 🌐 AI氣道公式サイトで最新情報をチェック

AI氣道 | AIエージェントと音声技術で広がる可能性を一緒に探求しよう

この記事が参考になったら、ぜひAI氣道.jp無料メルマガに登録して、毎日の朝LIVEブログをお届けさせてください。また、AIを使って人生を変えたい方は人生が開花する30日メルマガや、自分の強みを知りたい方はあなたの富を生み出す神様タイプ診断もおすすめだよ。

いろんなAI診断を楽しみたい人は「AI診断フェス」をチェックしてみてね。ドラクエ風に楽しく本格な「ドラゴンビジネス3」も人気だよ。そして多田啓二(ただっち)のホームページはこちらからチェックできるよ。