🧭 この記事でわかること(目次)

- ☕ はじめに — ライブの狙いと私の立場

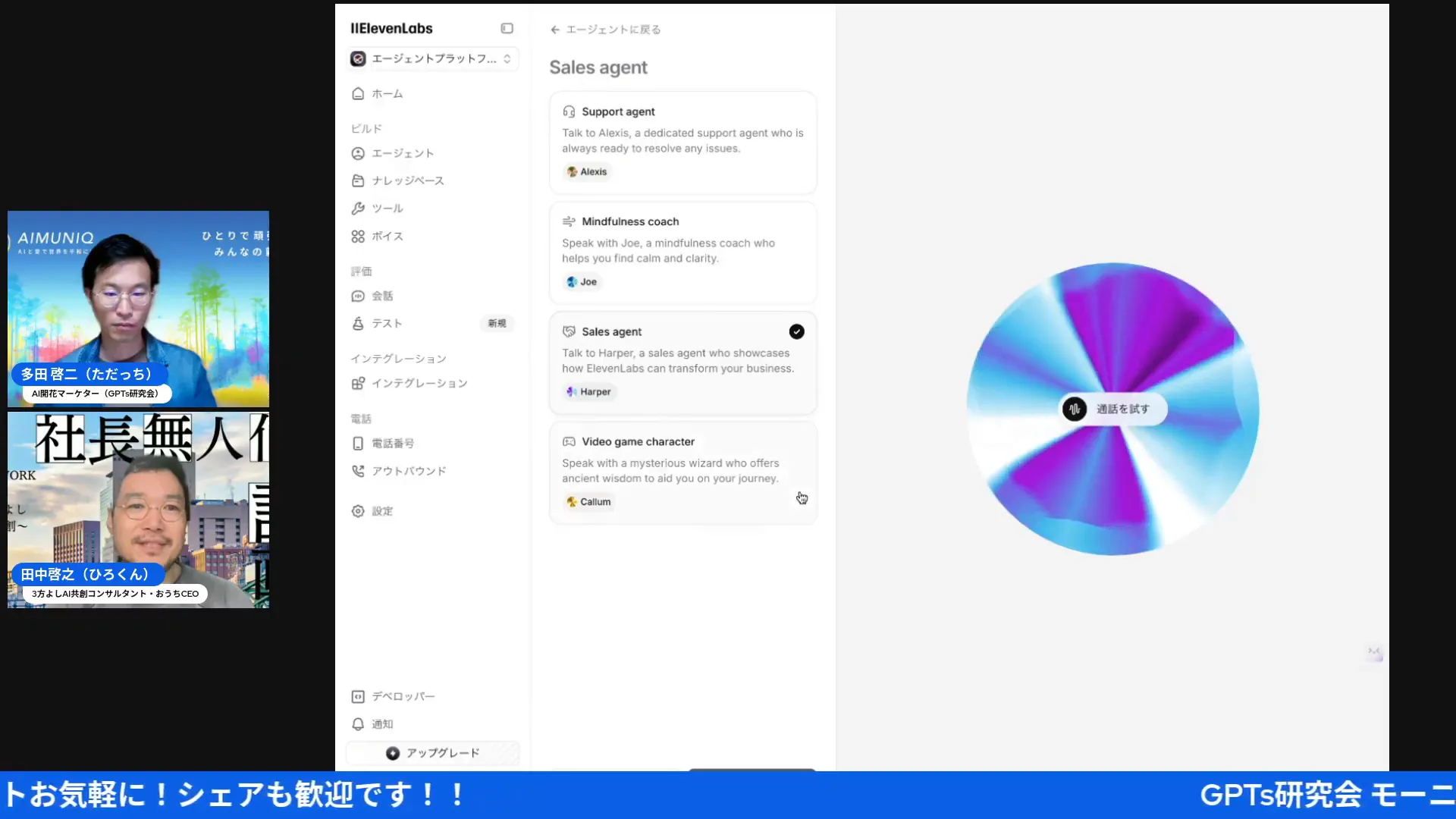

- 🎙️ elevenlabs(イレブンラボ)を触ってみた:声のクオリティが想像以上

- 🗣️ AI音声デモの振り返り — キャラ設計(役割設定)と用途設計が肝

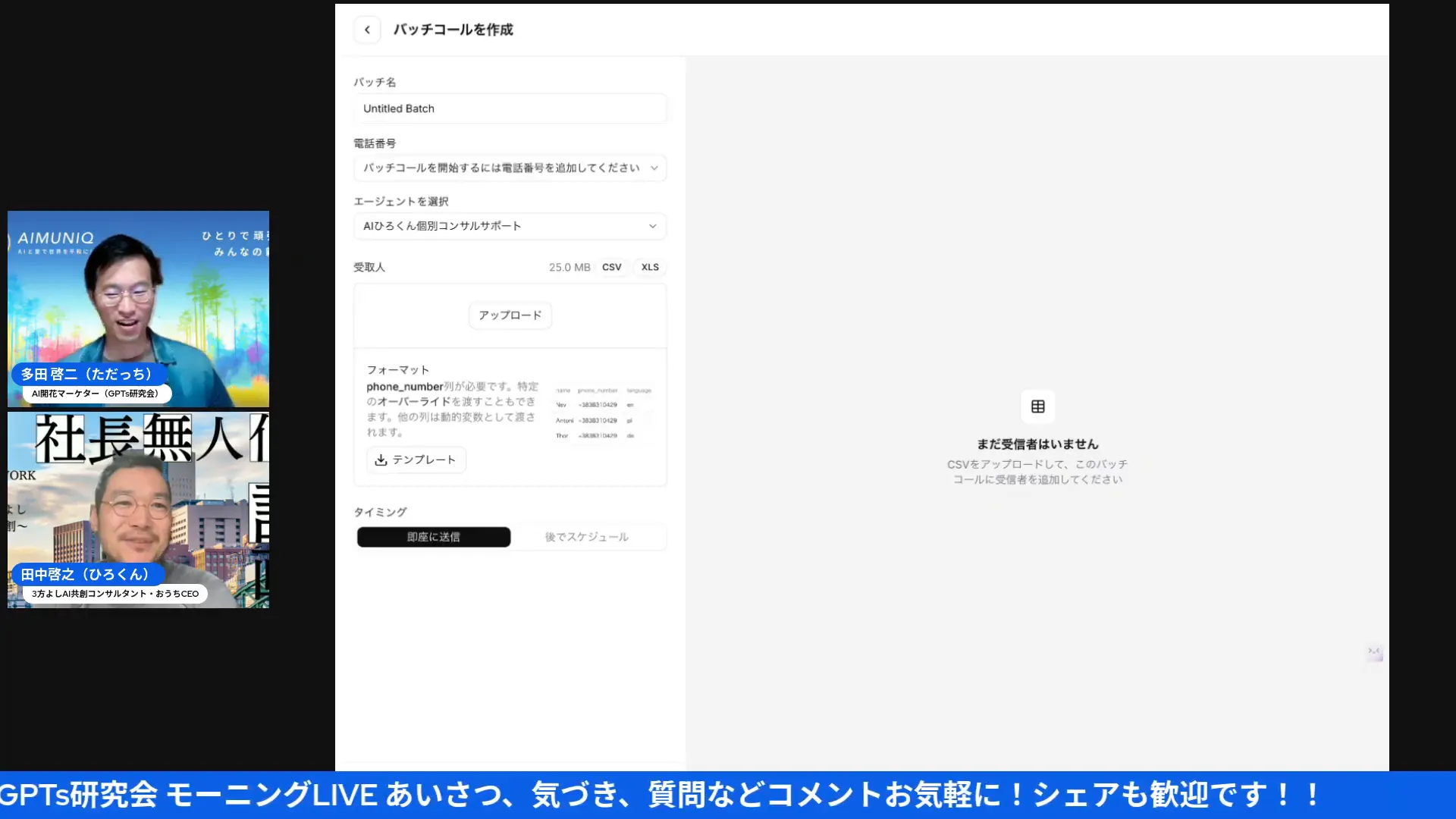

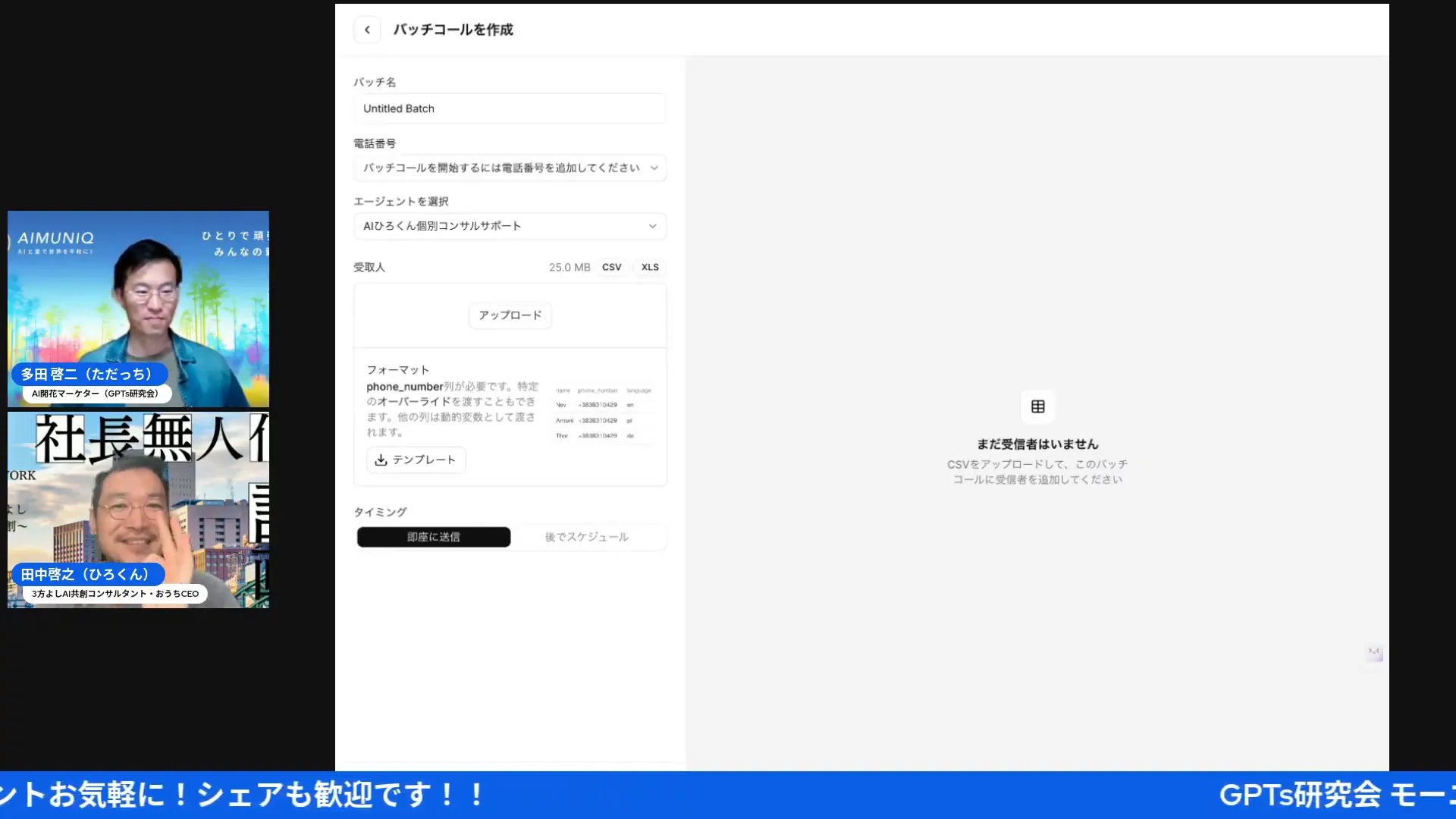

- 📞 電話領域でのAI活用 — 100人同時呼び出しの可能性

- 🔁 ワークフロー自動化とGeminiの活用(Googleワークスペース連携)

- 🧠 AIの心臓部:データ設計の核心(チャンクングとベクターデータベース)

- ⚙️ 実践:elevenlabs + Gemini APIで簡単エージェント作成(ステップバイステップ)

- 💡 実例:呼び出し〜情報提供のクイックフロー(シンプル版)

- 🔐 倫理とリスク管理 — 音声AI導入で絶対に考えるべきこと(3方よしの視点)

- 🔍 私がライブで強調した「遊びながら学ぶ」の具体的方法

- 📈 ビジネスモデルと収益化のヒント(スモールスタートが鍵)

- 🧩 実務で使えるプロンプトとテンプレート集

- ⚠️ よくある失敗パターン(AIは新人アシスタント)とその改善法

- 🤝 田中啓之の実践的ワンポイントアドバイス

- ❓ FAQ(よくある質問)

- 📎 参考キャプチャまとめ(時系列)

- 🎯 最後に — 私からのメッセージ

- 補足資料とすぐ使えるテンプレート

☕ はじめに — ライブの狙いと私の立場

まず最初に言っておきたいのは、今回のライブは「遊びながら学ぶ」ことを目的にしている点ね。AIって堅苦しく捉えられがちだけど、僕は「触ってみて、驚きながら改善する」アプローチが一番早く身につくと思ってる。私、田中啓之は事業家であり主夫で、過去に50kgのダイエット経験があって、転んでも起き上がるタイプ。AIも同じで試行錯誤の繰り返しで爆速で進化していくんだよね。 ライブでは elevenlabs(イレブンラボ:高品質なAI音声を生成できる注目のツール)を「スペシャルゲスト」として呼んで、実際に声を出してもらったり、エージェントを作って動かしてみた。リアルな感想をそのままシェアすると、AI音声は可能性の塊。でも、ただ声を出すだけじゃ不十分。 家庭で言えば、高性能なオーブン(AIツール)があっても、美味しいパンを焼くには『レシピ(プロンプト)』と『材料の準備(データ設計)』が欠かせないのと同じです。この記事では、その「レシピ」と「材料準備」のコツを解説するよ。🎙️ elevenlabs(イレブンラボ)を触ってみた:声のクオリティが想像以上

- 音声クオリティが高く、キャラクターの幅も広い — 若い声から落ち着いたナレーション風まで、驚くほど自然な声が簡単に選べる。

- 日本語対応が良い — 日本人に馴染むイントネーションや表現のチューニング(微調整)が比較的楽。

- エージェント作成がボタン操作で可能 — 専門的なコードを書かなくても、まるで新しいスタッフを雇うように、AIに「こういう話し方で、こういう応答をしてね」と設定できるんだ。

elevenlabsのユースケース(すぐ試せる)

- 動画や広告のナレーション生成:台本を投げればすぐに高品質な音声が作れる。

- 音声チャットボット:会社のウェブサイトで、FAQ(よくある質問)を読み上げる係として導入。

- 教育コンテンツの音声化:講義スライドを読み上げる教材にしたり、子ども向けの絵本の読み聞かせ音声を作ったりできる。

- キャラクター音声マーケティング:ブランドの「公式の声」を作って、顧客対応や情報発信に一貫性を持たせる。

🗣️ AI音声デモの振り返り — キャラ設計(役割設定)と用途設計が肝

- 誰に向けて話すのか(ペルソナ):例)レストランのウェイター役なら丁寧な言葉遣い、友だち役なら気さくな話し方。

- 何を伝えたいのか(目的):例)商品の魅力を伝えるのか、単に時間をお知らせするのか。

- どんな感情を出したいのか(トーン):例)緊急事態なら焦った声、お祝いなら明るい声。

📞 電話領域でのAI活用 — 100人同時呼び出しの可能性

- リマインダー電話:美容院や病院の「明日のご予約、お忘れではないですか?」という確認電話。

- 簡易コールセンターの一次対応:「ご用件は1(製品について)、2(修理)、3(その他)のどれですか?」という問い合わせの振り分け。

- 自動アンケート収集:「サービス満足度を1〜5で教えてください」という音声での回答受付。

- 地域の見守りコール:高齢者の安否確認「今日の体調はいかがですか?」や家族への自動連絡。

電話AI導入の実務チェックリスト

- スクリプト設計(分岐と「人間に繋ぐタイミング」を明確に)

- 音声品質テスト(雑音がある場所や、様々なスマホ機種でテスト)

- ログ保存と解析(会話データを保管し、AIの回答を改善するために分析)

- 個人情報保護(「この通話はAIが録音します」という同意取得フロー)

- 緊急時の人間へのエスカレーション設計(最重要)

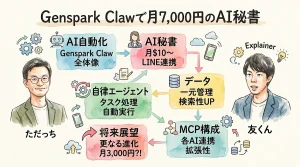

🔁 ワークフロー自動化とGeminiの活用(Googleワークスペース連携)

- 多くのルーチンワーク(面倒な繰り返し作業)はワークフロー化できる。

- AIを組み込むことで、単なる作業だけでなく「判断」や「文章生成」まで自動化できる。

- 人的ミス(うっかりミス)を減らし、仕事のスピードを上げられる。

- 商談終了後、CRM(顧客管理ツール)にステータス更新

- AI(Gemini)が議事録(Googleドキュメント)から次アクションを抽出

- 自動でフォローメール文(Gmail)を生成して担当が確認

- 承認で送信、未承認は担当へ差戻し

🧠 AIの心臓部:データ設計の核心(チャンクングとベクターデータベース)

- FAQの強化:ユーザー質問→その質問と「意味が近い」回答チャンクを本棚から検索して提示。

- ナレッジ検索:過去の議事録やメールから「今回の案件と似ている」情報を抽出。

- パーソナライズ:ユーザーの過去の行動履歴と「意味が近い」商品を提案。

- チャンクの粒度(切り分ける大きさ)を業務に合わせて最適化すること。

- メタデータ(そのページが「いつ」「誰が」書いたかという付箋)を必ずつけること。(これがないと、AIは平気で10年前の古い情報を答えてしまう!)

- 定期的にリトレーニング(本棚の並べ替え)をしてベクトルを更新すること。

⚙️ 実践:elevenlabs + Gemini APIで簡単エージェント作成(ステップバイステップ)

導入ステップ(簡易版)

- 目的定義:エージェントで何を解決したいか明確化(例:美容院の予約リマインド電話を自動化)

- データ収集:AIに学習させたい教科書(マニュアル、FAQ、過去の会話)を集める。

- チャンク分割:ドキュメントを意味ある粒度(例:質問と回答のセット)で分割。

- ベクトル化:チャンクを埋め込み(embedding)して「魔法の本棚」(ベクターDB)へ保存。

- エージェント設計:AIの話し方(トーン)、応答テンプレート、人間に引き継ぐルール(エスカレーション)を決める。

- 統合テスト:elevenlabsで音声、Geminiで言語処理を繋いで動かす。

- 品質改善:ログ(会話記録)を解析して「こういう時は、こう答えた方が良かったね」とAIにフィードバックするループを回す。

💡 実例:呼び出し〜情報提供のクイックフロー(シンプル版)

- 顧客リストから自動で発信(音声は elevenlabs で生成)

- 顧客が応答したらGeminiにより会話解析(「はい」「もしもし」などを認識)

- 顧客の回答(例:「何の件?」)に応じて、ベクターDBから最適なFAQチャンクを検索して回答

- 顧客が「担当者と話したい」と言った場合、人間オペレーターへ転送(エスカレーション)

- 会話ログは自動で保存し、翌日の改善リストに反映

🔐 倫理とリスク管理 — 音声AI導入で絶対に考えるべきこと(3方よしの視点)

- 本人性の問題:誰の声を使うか。自分の声を勝手にAIに学習させられたら怖いですよね。第三者の声を無断で真似るのは絶対に避ける。

- 誤情報のリスク:重要情報(金額、日時、住所など)は二重チェックするか、AIに読み上げさせず人間に回す。エスカレーション確保は必須。

- 個人情報保護:通話ログや顧客データの扱い(誰が見られるか、いつ破棄するか)を明文化し、厳格に管理する。

- 同意取得(透明性):「この通話は、品質向上のためAIが対応・録音しています」と正直に伝えること。これが信頼の土台。

- 品質保証:定期的に音声と応答の品質テストを行う(例:わざと曖昧な質問をして、AIが混乱しないか試す)。

🔍 私がライブで強調した「遊びながら学ぶ」の具体的方法

- 1日30分、AIツールを触るルーティンを作る。(例:今日のニュースをAIに要約させてみる、自分のブログをAIに読み上げさせてみる)

- 小さな課題を設定する(例:1週間で音声で5つのFAQを自動化)

- 失敗を公開する(社内やコミュニティで「こうやったらAIが変な回答をした」と共有して改善サイクルを回す)

- ユーザー目線でのテストを優先する(実際の顧客や家族に使ってもらい、感想を聞く)

📈 ビジネスモデルと収益化のヒント(スモールスタートが鍵)

- サブスクリプション型:エージェントの運用・保守を月額で提供(または利用)。「月額数千円で電話の一次対応だけ任せる」といったスモールスタートが賢い。

- 成果報酬型:問い合わせ削減数やリード(見込み客)獲得数に応じた報酬。

- パッケージ販売:初期構築+テンプレート提供で一括販売。

- コンテンツ化:生成した音声やナレーションをライブラリ化して販売。

🧩 実務で使えるプロンプトとテンプレート集

ここではすぐ使えるプロンプトやテンプレートを出しておく。elevenlabsやGeminiを想定したものだよ。音声ナレーション用テンプレート(elevenlabs向け)

- 用途:商品紹介ナレーション(30秒)

- 指示:「落ち着いた30代の男性ナレーター。信頼感が重要。テンポはややゆっくり。商品は<商品名>。特徴を3つ(<特徴1>、<特徴2>、<特徴3>)、最後に行動喚起(<例:詳しくはウェブで>)を1つ。」

エージェント応答プロンプト(Gemini向け)

- システム:あなたは親切で正確なカスタマーサポートです。敬語で対応。重要なポイント(日時、金額など)は必ず復唱して確認を取る。不明な点は「確認します」と言い、人間に引き継ぐ。

- ユーザープロンプト:「<ユーザー発話>」

- 期待出力:要約(1行)、提案(3つ以内)、追加確認事項(最大2つ)

⚠️ よくある失敗パターン(AIは新人アシスタント)とその改善法

導入でよく見る失敗は以下の通り。僕はこれで何度もハマったけど、対策もわかってるよ。- 失敗1:データが汚い — 比喩:腐った食材(古い情報、間違ったデータ)で美味しい料理(良い回答)は作れない。対策:学習用データの「お掃除」(クレンジング)を最優先に。

- 失敗2:運用体制がない — 対策:AIの「教育係」(オーナー)と改善計画(学習スケジュール)を明確に。野放しはダメ。

- 失敗3:期待値が高すぎる — 比喩:AIは魔法の杖ではなく、新人のアシスタント。対策:最初は簡単な定型業務から任せ、失敗を修正しながら育てる(MVPで小さく始める)。

- 失敗4:監査ログがない — 対策:全会話ログを暗号化して保管し、アクセス権管理を徹底。「いつAIが何を言ったか」を追跡できないのは致命的。

🤝 田中啓之の実践的ワンポイントアドバイス

最後に、僕からの実務的なアドバイスを3つだけシンプルに。- まず触る。触らないと始まらない。1日30分の実験ルーティンを作ろう。

- まず人間の品質担保を残す。AIは補助。完全自動は後からでOK。最初は「AIが下書き→人間がチェック」で十分。

- 透明性を担保する。(同意、ログ、説明責任)。これが顧客や社会との信頼関係の基礎。

❓ FAQ(よくある質問)

elevenlabsは日本語のイントネーションにどの程度対応していますか?

日本語のイントネーションや話し方にかなり対応しています。特にナレーションやキャラクターボイスでは自然な発音の選択肢が多く、用途に応じてテンポやトーンを調整できます。ただし、微妙な方言や局所的な言い回しは手動で調整する必要があります。

電話AIは法律的に問題ありませんか?

法的リスクはあるため、個人情報の取り扱い、同意取得、誤案内による損害リスクを事前に評価し、弁護士やコンプライアンス担当と設計することを推奨します。特に金融や医療分野では規制が厳しいので注意が必要です。

ベクターデータベースの導入は中小企業でも現実的ですか?

はい。クラウド型のベクトルDBサービス(例:Pinecone、Weaviateなど)を使えば初期費用を抑えて導入できます。重要なのはデータ設計とメタデータの整備なので、まずは少量でプロトタイプを作るのが現実的です。今回ご紹介のGoogleのAPIはかなり注目。

AIが生成した音声の権利はどうなりますか?

ツールや契約に依存します。商用利用可のライセンスを確認する必要があります。有名人の声に似せるなどの行為は著作権や肖像権に抵触する可能性が高いので避けるべきです。

小さく始める具体的なMVPの例は?

例として「FAQの音声化MVP」が良いです。10件程度のFAQを選び、elevenlabsで音声を作成、ウェブサイトや電話の一次応答に組み込み、1ヶ月で効果を測定する。費用対効果が見えやすく、改善もしやすいですよ。

GeminiとChatGPTの使い分けはどうすればいい?

機能は重なる部分がありますが、GeminiはGoogleエコシステム(ワークスペースや検索)との親和性が高い点が強み。ChatGPTは柔軟なプロンプトとエコシステム(APIやプラグイン)が強み。既存のツールや運用フローに合わせて選ぶのが現実的です。

📎 参考キャプチャまとめ(時系列)

ライブの主要キャプチャとタイムスタンプをまとめておくね。クリック(またはコピーしてブラウザに貼り付け)するとその時間に飛べるURLを併記しているよ。- elevenlabs起動の様子 — 06:11(https://www.youtube.com/watch?v=u4F-gcqeHX8&t=371s)

- 音声キャラ実演 — 08:48(https://www.youtube.com/watch?v=u4F-gcqeHX8&t=528s)

- 電話100人同時呼び出しの話 — 17:51(https://www.youtube.com/watch?v=u4F-gcqeHX8&t=1071s)

- ワークフロー連携(Gemini/Workspace) — 23:06(https://www.youtube.com/watch?v=u4F-gcqeHX8&t=1386s)

- ベクタDBとチャンクングの解説 — 25:26(https://www.youtube.com/watch?v=u4F-gcqeHX8&t=1526s)

- ビジネス・まとめパート — 29:41(https://www.youtube.com/watch?v=u4F-gcqeHX8&t=1781s)

🎯 最後に — 私からのメッセージ

AIは道具であり、共創相手でもある。僕は「分身AIで社長無人化計画」を本気で進めているけど、その根底にあるのは「人のやりたいことを増やす」こと。日常の面倒な部分、ルーチン、判断の補助はAIに任せて、あなたはもっと創造的なことに時間を使おうよ。 もしこの記事を読んで「まず何から始めたらいいか分からない」と感じたら、まずは小さな実験を一つ提案するね。1週間で作れる「FAQ音声化MVP」を一緒に作ろう。少額・短期間で効果が見えるから、次の一手が判断しやすくなるよ。 それでは、また次の実験で会おう。AIは遊べば遊ぶほど賢くなる。僕も一緒に学んでいくから、皆も一歩踏み出してみてね。応援してるよ。 — 田中啓之(ひろくん)

GPTs研究会はこちら! |

|

無料!AI最新情報コミュニティ |

| 今すぐGPTs研究会をチェック! |

🎯 AIと愛で、未来をひらく。「あいあいらぼ。」

起業家・経営者のためのAI実践型コミュニティ。AI実践ワークショップ・AIクリエイティブ会・AI目標達成会が月額5,500円で遊び放題!AIMUNIQ(株)主催。

この記事が参考になったら、ぜひAI氣道.jp無料メルマガに登録して、毎日の朝LIVEブログをお届けさせてください。また、AIを使って人生を変えたい方は人生が開花する30日メルマガや、自分の強みを知りたい方はあなたの富を生み出す神様タイプ診断もおすすめだよ。

いろんなAI診断を楽しみたい人は「AI診断フェス」をチェックしてみてね。ドラクエ風に楽しく本格な「ドラゴンビジネス3」も人気だよ。そして多田啓二(ただっち)のホームページはこちらからチェックできるよ。